Come ottimizzare l'intralogistica per razionalizzare e velocizzare le supply chain dell'Impresa 4.0 - Parte 2 di 2

Contributo di Editori nordamericani di DigiKey

2023-09-22

Nella Parte 1 di questa serie sull'intralogistica sono state discusse le questioni relative all'utilizzo di robot mobili autonomi (AMR) e veicoli a guida automatica (AGV) a livello di sistema per l'implementazione dell'intralogistica e la movimentazione rapida e sicura dei materiali secondo le necessità. Questo articolo si concentra sui casi d'uso e sul modo in cui AMR e AGV utilizzano i sensori per identificare e tracciare gli oggetti, sul modo in cui l'apprendimento automatico (ML) e l'intelligenza artificiale (IA) supportano l'identificazione, lo spostamento e la consegna dei materiali nei magazzini e negli stabilimenti di produzione.

L'intralogistica utilizza robot mobili autonomi (AMR) e veicoli a guida automatica (AGV) per lo spostamento efficiente dei materiali all'interno dei magazzini e degli stabilimenti di produzione dell'Impresa 4.0. Per razionalizzare e velocizzare le supply chain, i sistemi di intralogistica devono conoscere la posizione attuale del materiale, la sua destinazione prevista e il percorso più sicuro ed efficiente per raggiungerla. Questa navigazione razionalizzata richiede una varietà di sensori.

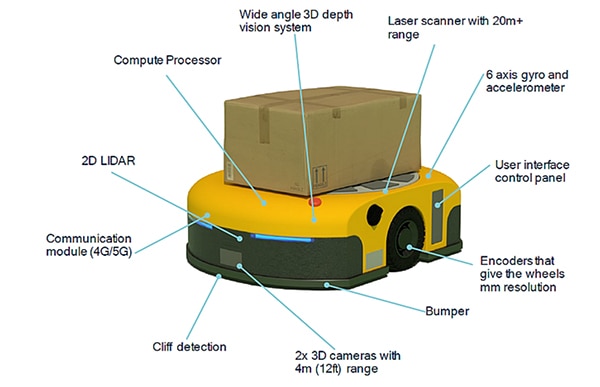

Nelle soluzioni di intralogistica, gli AGV e gli AMR utilizzano sensori per aumentare la propria consapevolezza situazionale. Gli array di sensori garantiscono la sicurezza del personale nelle vicinanze, la protezione delle altre attrezzature, nonché la navigazione e la localizzazione efficienti. A seconda dei requisiti dell'applicazione, le tecnologie dei sensori per gli AMR possono includere sensori di contatto quali interruttori di finecorsa integrati nei paracolpi, tecnologia di telerilevamento LiDAR 2D e 3D, ultrasuoni, telecamere 2D e stereo, radar, encoder, unità di misurazione inerziale (IMU) e fotocellule. Per gli AGV, i sensori possono includere sensori di linea magnetici, induttivi o ottici, nonché interruttori di finecorsa integrati nei paracolpi, LiDAR 2D ed encoder.

Il primo articolo di questa serie tratta le questioni relative all'utilizzo di AMR e AGV a livello di sistema per l'implementazione dell'intralogistica e la movimentazione efficiente dei materiali secondo le necessità.

Questo articolo è incentrato sulla fusione sensoriale e su come gli AMR e gli AGV utilizzano combinazioni di sensori, IA e ML per la localizzazione, la navigazione e la sicurezza operativa. L'articolo inizia con una breve rassegna dei sensori più comuni presenti negli AGV, esamina la posa del robot e gli algoritmi SLAM (localizzazione e mappatura simultanee) che utilizzano la fusione sensoriale, valuta in che modo le stime SLAM possano essere migliorate con tecniche di abbinamento scansione-mappa e scansione-scansione, e si conclude con un'analisi di come la fusione sensoriale contribuisca al funzionamento sicuro di AMR e AGV. In tutti questi casi, DigiKey supporta i progettisti con un'ampia gamma di sensori e interruttori per la robotica e altre applicazioni industriali.

Per supportare il funzionamento autonomo e la sicurezza degli AMR sono necessari una serie di sensori e la fusione sensoriale, nonché IA, ML e connettività wireless. Sebbene le prestazioni richieste agli AGV siano inferiori, essi si affidano comunque a molteplici sensori per supportare un funzionamento sicuro ed efficiente. Esistono due categorie principali di sensori:

- I sensori propriocettivi misurano valori interni al robot quali la velocità delle ruote, il carico, la carica della batteria e così via.

- I sensori esterocettivi forniscono informazioni sull'ambiente del robot, quali la misurazione della distanza, la posizione dei punti di riferimento e l'identificazione degli ostacoli, come le persone che entrano nel percorso del robot.

La fusione sensoriale negli AGV e negli AMR si basa su combinazioni di sensori propriocettivi ed esterocettivi. Ecco alcuni esempi di sensori negli AMR (Figura 1):

- Scanner laser per il rilevamento di oggetti con portata di oltre 20 metri

- IMU con giroscopio e accelerometro a 6 assi e, talvolta, magnetometro

- Encoder con risoluzione millimetrica sulle ruote

- Sensore di contatto, come un microinterruttore nel paracolpi, per arrestare immediatamente il movimento in caso di contatto con un oggetto imprevisto

- Due telecamere 3D con visione in avanti e raggio d'azione di 4 m

- Sensore rivolto verso il basso per rilevare il bordo di una piattaforma

- Moduli di comunicazione per fornire connettività, che possono opzionalmente offrire il rilevamento Bluetooth dell'angolo di arrivo (AoA) e dell'angolo di partenza (AoD) per i servizi di localizzazione in tempo reale (RTLS) o i punti di trasmissione/ricezione (TRP) 5G per tracciare una griglia con precisione al centimetro

- LiDAR 2D per calcolare la vicinanza degli ostacoli davanti al veicolo

- Sistema di visione con profondità 3D grandangolare adatto all'identificazione e alla localizzazione di oggetti

- Processore di calcolo ad alte prestazioni a bordo per fusione sensoriale, IA e ML

Figura 1: AMR di esempio che mostra la varietà e la collocazione dei sensori incorporati. (Immagine per gentile concessione di Qualcomm)

Figura 1: AMR di esempio che mostra la varietà e la collocazione dei sensori incorporati. (Immagine per gentile concessione di Qualcomm)

Posa del robot e fusione sensoriale

La navigazione AMR è un processo complesso. Uno dei primi passaggi prevede che l'AMR sappia dove si trova e in che direzione è rivolto. Questa combinazione di dati è chiamata "posa del robot". Il concetto di posa può essere applicato anche ai bracci e agli effettori finali dei robot stazionari multiasse. La fusione sensoriale combina gli input provenienti dall'IMU, dagli encoder e da altri sensori per determinare la posa. L'algoritmo della posa stima la posizione (x, y) del robot e l'angolo di orientamento θ, rispetto agli assi delle coordinate. La funzione q = (x, y, θ) definisce la posa del robot. Per quanto riguarda gli AMR, le informazioni sulla posa hanno una serie di utilizzi, ad esempio:

- La posa di un intruso, come una persona che si avvicina al robot, rispetto a un quadro di riferimento esterno o rispetto al robot

- La posa stimata del robot dopo essersi spostato a una determinata velocità per un tempo predeterminato

- Calcolo del profilo di velocità necessario al robot per spostarsi dalla sua posa attuale a una seconda posa

La posa è una funzione predefinita in diversi ambienti di sviluppo di software per robot. Ad esempio, il pacchetto robot_pose_ekf è incluso nel Robot Operating System (ROS), una piattaforma di sviluppo open-source. Robot_pose_ekf può essere usato per stimare la posa 3D di un robot sulla base di misurazioni (parziali) della posa ricevute da vari sensori. Utilizza un filtro di Kalman esteso con un modello 6D (posizione 3D e orientamento 3D) per combinare le misurazioni dell'encoder per l'odometria delle ruote, della telecamera per l'odometria visiva e dell'IMU. Poiché i vari sensori operano con velocità e latenze diverse, robot_pose_ekf non richiede che tutti i dati dei sensori siano disponibili in modo continuo o simultaneo. Ogni sensore viene utilizzato per fornire una stima della posa con una covarianza. Robot_pose-ekf identifica le informazioni dei sensori disponibili in qualsiasi momento e si regola di conseguenza.

Fusione sensoriale e SLAM

Molti ambienti in cui operano gli AMR includono ostacoli variabili che possono anche spostarsi. Benché utile, una mappa di base della struttura non basta, occorre altro. Quando si muovono all'interno di un impianto industriale, gli AMR hanno bisogno di qualcosa di più delle informazioni di posa; per garantire un funzionamento efficiente, devono utilizzare anche l'algoritmo SLAM. Lo SLAM aggiunge la mappatura dell'ambiente in tempo reale per supportare la navigazione. Due approcci fondamentali allo SLAM sono:

- SLAM visivo che abbina una telecamera a una IMU

- SLAM LiDAR che combina un sensore laser come LiDAR 2D o 3D con una IMU

Lo SLAM LiDAR può essere più preciso di quello visivo, ma è generalmente più costoso da implementare. In alternativa, è possibile utilizzare il 5G per fornire informazioni di localizzazione per migliorare le stime dello SLAM visivo. L'uso di reti 5G private in magazzini e fabbriche può potenziare i sensori incorporati per lo SLAM. Alcuni AMR implementano il posizionamento preciso in ambienti interni utilizzando i punti di trasmissione/ricezione (TRP) 5G per tracciare una griglia con precisione al centimetro sugli assi x, y e z.

Il successo della navigazione si basa sulla capacità di un AMR di adattarsi a elementi ambientali mutevoli. La navigazione combina SLAM visivo e/o SLAM LiDAR, tecnologie di overlay come TRP 5G e ML per rilevare i cambiamenti nell'ambiente e fornire aggiornamenti costanti sulla posizione. La fusione sensoriale supporta lo SLAM in diversi modi:

- Aggiornamenti continui del modello spaziale e semantico dell'ambiente in base agli input provenienti da vari sensori, utilizzando l'IA e il ML

- Identificazione degli ostacoli, per consentire agli algoritmi di pianificazione del percorso di effettuare le regolazioni necessarie e trovare il percorso più efficiente attraverso l'ambiente

- Implementazione del piano del percorso, che richiede un controllo in tempo reale per modificare il percorso pianificato, comprese la velocità e la direzione dell'AMR, al variare dell'ambiente

Quando lo SLAM non è sufficiente

Pur essendo uno strumento fondamentale per la navigazione AMR efficiente, lo SLAM da solo non è sufficiente. Come gli algoritmi di posa, lo SLAM è implementato con un filtro di Kalman esteso che fornisce valori stimati. I valori stimati dallo SLAM estendono i dati di posa, aggiungendo tra le altre cose velocità lineari e rotazionali e accelerazioni lineari. La stima SLAM è un processo in due passaggi: il passaggio iniziale prevede la compilazione di previsioni utilizzando l'analisi dei sensori interni in base alle leggi fisiche del movimento; il secondo passaggio della stima SLAM prevede la lettura di sensori esterni per affinare le stime iniziali. Questo processo in due passaggi aiuta a eliminare e correggere i piccoli errori che possono accumularsi nel tempo generando errori significativi.

Lo SLAM dipende dalla disponibilità degli input dei sensori. In alcuni casi, il LiDAR 2D a basso costo potrebbe non funzionare, ad esempio se non ci sono oggetti nella linea di vista diretta del sensore. In questi casi, le telecamere stereo 3D o il LiDAR 3D possono migliorare le prestazioni del sistema. Tuttavia, le telecamere stereo 3D o il LiDAR 3D sono più costosi e richiedono una maggiore potenza di calcolo per l'implementazione.

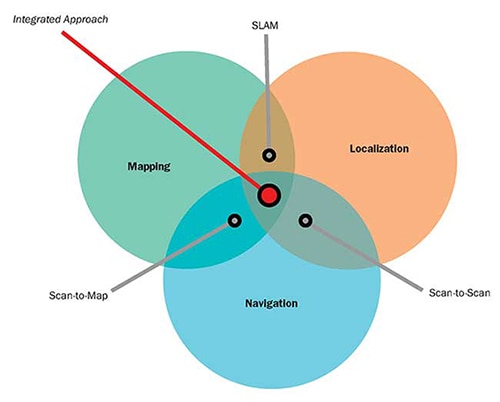

Un'altra alternativa è quella di utilizzare un sistema di navigazione che integri lo SLAM con tecniche di abbinamento scansione-mappa e scansione-scansione che possono essere implementate utilizzando solo sensori LiDAR 2D (Figura 2):

- L'abbinamento scansione-mappa utilizza i dati di telemetria LiDAR per stimare la posizione dell'AMR facendo corrispondere le misurazioni di telemetria a una mappa memorizzata. L'efficacia di questo metodo dipende dall'accuratezza della mappa. Non subisce derive nel tempo, ma in ambienti ripetitivi può dare luogo a errori difficili da identificare, che possono causare variazioni discontinue della posizione percepita ed essere difficili da eliminare.

- L'abbinamento scansione-scansione utilizza dati di telemetria LiDAR sequenziali per stimare la posizione di un AMR tra le scansioni. Questo metodo fornisce informazioni aggiornate sulla posizione e sulla posa dell'AMR indipendentemente da qualsiasi mappa esistente e può essere utile durante la creazione della mappa. Tuttavia, si tratta di un algoritmo incrementale che può essere soggetto a derive nel tempo senza la possibilità di identificare le imprecisioni introdotte dalla deriva.

Figura 2: Per integrare e migliorare le prestazioni dei sistemi SLAM, è possibile utilizzare algoritmi di abbinamento scansione-mappa e scansione-scansione. (Immagine per gentile concessione di Aethon)

Figura 2: Per integrare e migliorare le prestazioni dei sistemi SLAM, è possibile utilizzare algoritmi di abbinamento scansione-mappa e scansione-scansione. (Immagine per gentile concessione di Aethon)

La fusione sensoriale è necessaria per la sicurezza

La sicurezza è una preoccupazione fondamentale per gli AGV e gli AMR, e devono essere presi in considerazione diversi standard. Alcuni esempi: American National Standards Institute / Industrial Truck Standards Development Foundation (ANSI/ITSDF) B56.5 - 2019, Safety Standard for Driverless, Automatic Guided Industrial Vehicles and Automated Functions of Manned Industrial Vehicles, ANSI / Robotic Industrial Association (RIA) R15.08-1-2020 - Standard for Industrial Mobile Robots – Safety Requirements, diversi standard dell'International Standards Organization (ISO) e altri.

Il funzionamento sicuro di AGV e AMR richiede una fusione sensoriale che combini sensori LiDAR 2D certificati per la sicurezza (talvolta chiamati scanner laser di sicurezza) con encoder sulle ruote. La tecnologia LiDAR 2D supporta contemporaneamente due distanze di rilevamento, può avere un angolo di rilevamento di 270° e si coordina con la velocità del veicolo segnalata dagli encoder. Quando viene rilevato un oggetto nella zona di rilevamento più lontana (fino a 20 metri di distanza, a seconda del sensore), il veicolo può essere rallentato come necessario. Se l'oggetto entra nella zona di rilevamento più vicina nella linea di marcia, il veicolo si ferma.

I laser scanner di sicurezza vengono spesso utilizzati in gruppi di 4, uno su ogni angolo del veicolo. Possono funzionare come un'unica unità e comunicare direttamente con il controller di sicurezza a bordo del veicolo. Gli scanner sono disponibili e certificati per l'uso in applicazioni di categoria di sicurezza 3, livello di prestazioni d (PLd) e livello di integrità di sicurezza 2 (SIL2) e sono alloggiati in un involucro IP65 adatto per la maggior parte delle applicazioni all'aperto e al chiuso (Figura 3). Gli scanner includono un ingresso per le informazioni dell'encoder incrementale delle ruote per supportare la fusione sensoriale.

Figura 3: I sensori LiDAR 2D come questo possono essere combinati con gli encoder sulle ruote in un sistema di fusione sensoriale che garantisce il funzionamento sicuro di AMR e AGV. (Immagine per gentile concessione di Idec)

Figura 3: I sensori LiDAR 2D come questo possono essere combinati con gli encoder sulle ruote in un sistema di fusione sensoriale che garantisce il funzionamento sicuro di AMR e AGV. (Immagine per gentile concessione di Idec)

Conclusione

L'intralogistica supporta supply chain più rapide ed efficienti nei magazzini e nelle fabbriche dell'Impresa 4.0. Gli AMR e gli AGV sono strumenti importanti per l'intralogistica, per lo spostamento tempestivo e sicuro dei materiali da un luogo all'altro. La fusione sensoriale è necessaria per supportare le funzioni di AMR e AGV, quali la determinazione della posa, il calcolo dei dati SLAM, il miglioramento delle prestazioni di navigazione mediante l'abbinamento scansione-mappa e scansione-scansione e la garanzia di sicurezza per il personale e gli oggetti in tutta la struttura.

Esonero della responsabilità: le opinioni, le convinzioni e i punti di vista espressi dai vari autori e/o dai partecipanti al forum su questo sito Web non riflettono necessariamente le opinioni, le convinzioni e i punti di vista di DigiKey o le sue politiche.